De conventionele wijsheid zegt: "Als je niet wilt dat je gegevens worden gebruikt, trek je dan overal uit terug".

Wij zeggen: "Als je gegevens toch worden verzameld, is het verstandiger om invloed uit te oefenen op hoe ze worden gebruikt".

Het is niet: "Moeten bedrijven mijn gegevens hebben?" (Die hebben ze al).

De echte vraag is: "Moeten mijn gegevens bijdragen aan het bouwen van een betere AI voor iedereen?"

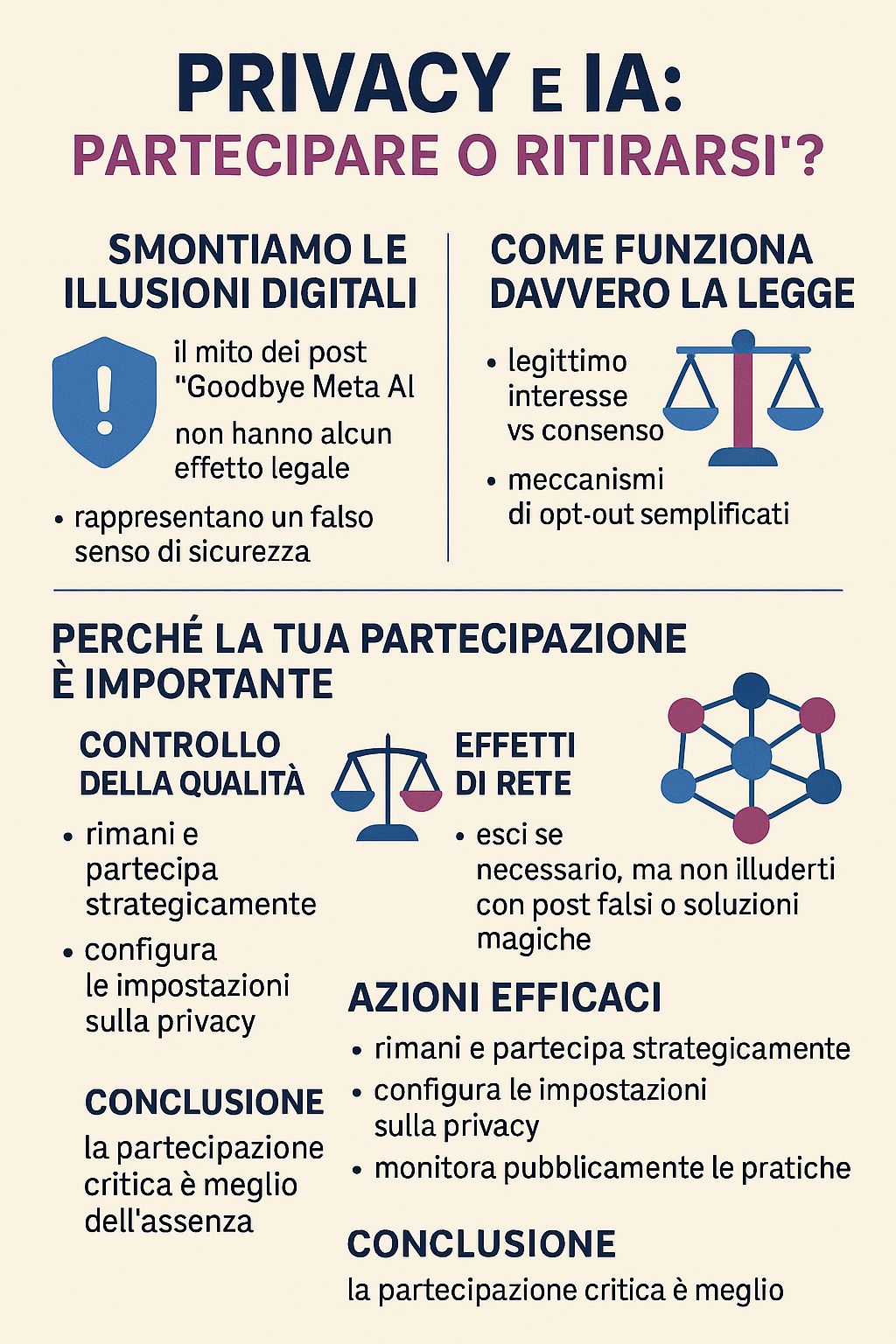

Voordat we een serieuze argumentatie opbouwen, is het van cruciaal belang om een gevaarlijke illusie te ontkrachten die op sociale media circuleert: de virale posts "Goodbye Meta AI" die beloven je gegevens te beschermen door simpelweg een bericht te delen.

De ongemakkelijke waarheid: deze berichten zijn volledig nep en kunnen je kwetsbaarder maken.

Zoals Meta zelf uitlegt, "is het delen van het bericht 'Goodbye Meta AI' geen geldige vorm van verzet". Deze berichten:

Het virale succes van deze posts legt een dieper liggend probleem bloot: we geven de voorkeur aan eenvoudige, illusoire oplossingen boven complexe, weloverwogen beslissingen. Door een post te delen, voelen we ons actief betrokken zonder dat we ons hoeven te verdiepen in hoe onze digitale rechten precies werken.

Maar privacy verdedig je niet met memes. Je verdedigt privacy met kennis en bewuste actie.

Vanaf 31 mei 2025 heeft Meta een nieuw regime voor AI-training ingevoerd, waarbij 'gerechtvaardigd belang' in plaats van toestemming als rechtsgrondslag wordt gebruikt. Dit is geen maas in de wet, maar een wettelijk instrument dat in de AVG is voorzien.

Het gerechtvaardigd belang stelt bedrijven in staat om gegevens te verwerken zonder uitdrukkelijke toestemming, mits zij kunnen aantonen dat hun belang niet zwaarder weegt dan de rechten van de gebruiker. Dit creëert een grijs gebied waarin bedrijven de wet door middel van interne beoordelingen 'op maat' toepassen.

Het gebruik van niet-geanonimiseerde gegevens brengt "grote risico's met zich mee op het gebied van modelomkering, memorization leaks en extraction vulnerabilities". De benodigde rekenkracht betekent dat alleen actoren met zeer grote capaciteiten deze gegevens effectief kunnen benutten, waardoor er systemische asymmetrieën ontstaan tussen burgers en grote bedrijven.

Nu we de juridische en technische realiteit hebben verduidelijkt, kunnen we het argument voor strategische participatie opbouwen.

Wanneer bewuste mensen afhaken, traint AI zich op degenen die overblijven. Wilt u dat AI-systemen voornamelijk gebaseerd zijn op gegevens van mensen die:

Vooringenomenheid in AI treedt op wanneer de trainingsgegevens niet representatief zijn. Uw deelname helpt om het volgende te garanderen:

AI-systemen worden beter naarmate ze groter en diverser worden:

Als je AI-gebaseerde functies gebruikt (zoeken, vertalen, aanbevelingen, toegankelijkheidstools), draagt je deelname bij aan het verbeteren ervan voor iedereen, inclusief toekomstige gebruikers die deze het hardst nodig hebben.

Je privacy verandert niet significant tussen opt-in en opt-out voor AI. Dezelfde gegevens worden al gebruikt voor:

Het verschil is of deze gegevens ook bijdragen aan het verbeteren van AI voor iedereen, of alleen dienen om de directe commerciële belangen van het platform te behartigen.

Dat is precies waarom verantwoordelijke mensen zoals jij zouden moeten meedoen. Je terugtrekken houdt de ontwikkeling van AI niet tegen, maar zorgt er alleen voor dat jouw stem niet meer meetelt.

AI-systemen zullen hoe dan ook worden ontwikkeld. De vraag is: met of zonder de bijdrage van mensen die kritisch over deze kwesties nadenken?

Begrijpelijk. Maar bedenk eens: zou je liever hebben dat AI-systemen worden gebouwd met of zonder de inbreng van mensen die jouw scepsis ten opzichte van grote bedrijven delen?

Je wantrouwen is juist de reden waarom jouw kritische deelname zo waardevol is.

Kunstmatige intelligentie wordt realiteit, of je er nu aan deelneemt of niet.

Je keuze is niet of AI zal worden ontwikkeld, maar of de AI die wordt ontwikkeld de waarden en perspectieven zal weerspiegelen van mensen die zorgvuldig over deze kwesties nadenken.

Opt-out is als niet stemmen. Het houdt de verkiezingen niet tegen, het betekent alleen dat het resultaat geen rekening houdt met jouw bijdrage.

In een wereld waarin alleen spelers met zeer hoge rekenkracht deze gegevens effectief kunnen interpreteren en benutten, kan jouw kritische stem in de training meer impact hebben dan jouw afwezigheid.

Blijf en neem strategisch deel als:

En ondertussen:

Maar maak jezelf geen illusies met:

Je individuele afmelding heeft een minimale invloed op je privacy, maar blijven heeft een reële invloed op iedereen.

In een wereld waarin AI-systemen de informatiestroom, beslissingen en interacties tussen mensen en technologie zullen bepalen, is de vraag niet of deze systemen moeten bestaan, maar of ze het standpunt van nadenkende en kritische mensen zoals jij moeten meenemen.

Soms is de meest radicale actie niet om op te geven. Vaak is de meest radicale manier om te blijven en ervoor te zorgen dat je stem wordt gehoord.

Anoniem

Het gaat er niet om blindelings te vertrouwen op bedrijven of bezorgdheden over privacy te negeren. Het gaat erom te erkennen dat privacy niet wordt verdedigd met memes, maar met strategische en bewuste participatie.

In een ecosysteem waar de machtsongelijkheid enorm is, kan je kritische stem in de training van AI meer impact hebben dan je protest tegen afwezigheid.

Wat je keuze ook is, kies bewust, niet op basis van digitale illusies.

Een paragraaf van sympathie ook voor de 'kluizenaars van de privacy' - die zuivere zielen die denken dat ze volledig aan digitale tracking kunnen ontsnappen door offline te leven als Tibetaanse monniken in 2025.

Spoiler: zelfs als je in een afgelegen hut in de Dolomieten gaat wonen, zijn je gegevens al overal te vinden. Je huisarts maakt gebruik van digitale systemen. De bank waar je je spaargeld voor het kopen van brandhout hebt staan, houdt elke transactie bij. De supermarkt in het dorp heeft camera's en elektronische betalingssystemen. Zelfs de postbode die je rekeningen bezorgt, draagt bij aan logistieke datasets die optimalisatiealgoritmen voeden.

Volledige digitale afzondering in 2025 betekent in wezen jezelf uitsluiten van de burgermaatschappij. Je kunt Instagram opgeven, maar je kunt niet het gezondheidszorg-, bank-, onderwijs- of werksysteem opgeven zonder dramatische gevolgen voor je levenskwaliteit.

En terwijl jij je anti-5G-hut bouwt, blijven je gegevens bestaan in de databases van ziekenhuizen, banken, verzekeringsmaatschappijen, gemeenten en belastingdiensten, en worden ze nog steeds gebruikt om systemen te trainen die toekomstige generaties zullen beïnvloeden.

Het paradox van de kluizenaar: je protest tegen isolatie verhindert niet dat AI-systemen worden getraind op basis van gegevens van mensen die zich hier minder bewust van zijn, maar het sluit je uit van de mogelijkheid om de ontwikkeling ervan in een meer ethische richting te beïnvloeden.

In wezen heb je de ongerepte morele zuiverheid veroverd van iemand die de geschiedenis vanaf de tribune gadeslaat, terwijl anderen – minder verlicht maar meer aanwezig – de spelregels schrijven.

Wat je keuze ook is, kies bewust, niet op basis van digitale illusies.

Geciteerde artikelen:

Meer informatie over de AVG en gerechtvaardigd belang:

Officiële bronnen:

Concrete maatregelen: als je in Europa woont, controleer dan de officiële opt-outprocedures bij de gegevensbeschermingsautoriteit. Raadpleeg voor algemene informatie de privacyinstellingen en servicevoorwaarden van je platform. En onthoud: geen enkele post op sociale media heeft juridische waarde.